Dernière mise à jour : 07/09/2024 à 10h00

Table des matières

Introduction

L'utilisation de modèles d'intelligence artificielle générative open source est en effet une option accessible pour de nombreuses applications personnelles telles que la rédaction de résumés ou la traduction de textes. Bien que ces modèles ne soient pas aussi avancés que ceux développés par des organisations comme OpenAI ou Anthropic, ils offrent néanmoins une performance remarquable pour les utilisateurs individuels. Il est important de noter que, malgré leur utilité, ces modèles peuvent parfois générer des informations incorrectes ou des hallucinations, où l'IA produit des données qui ne sont pas ancrées dans la réalité. C'est pourquoi il est crucial de toujours vérifier et critiquer les résultats fournis par ces IA, surtout lorsqu'ils sont utilisés dans des contextes où la précision est essentielle.

Les modèles de traitement du langage naturel, ou NLP, sont effectivement des outils puissants dans le domaine de l'IA générative. La taille des modèles open source varie généralement entre 4 et 40 Go, ce qui nécessite des systèmes informatiques avec une grande quantité de RAM pour les charger efficacement en mémoire. En plus de la RAM, un processeur (CPU) et une unité de traitement graphique (GPU) performants sont cruciaux pour optimiser l'expérience utilisateur. Il est vrai que plus un modèle est grand, plus il peut fournir des réponses précises et détaillées. Cependant, cela peut également entraîner une augmentation du temps de réponse. Trouver le bon équilibre entre la taille du modèle et les capacités de votre équipement est essentiel pour tirer le meilleur parti de ces technologies avancées.

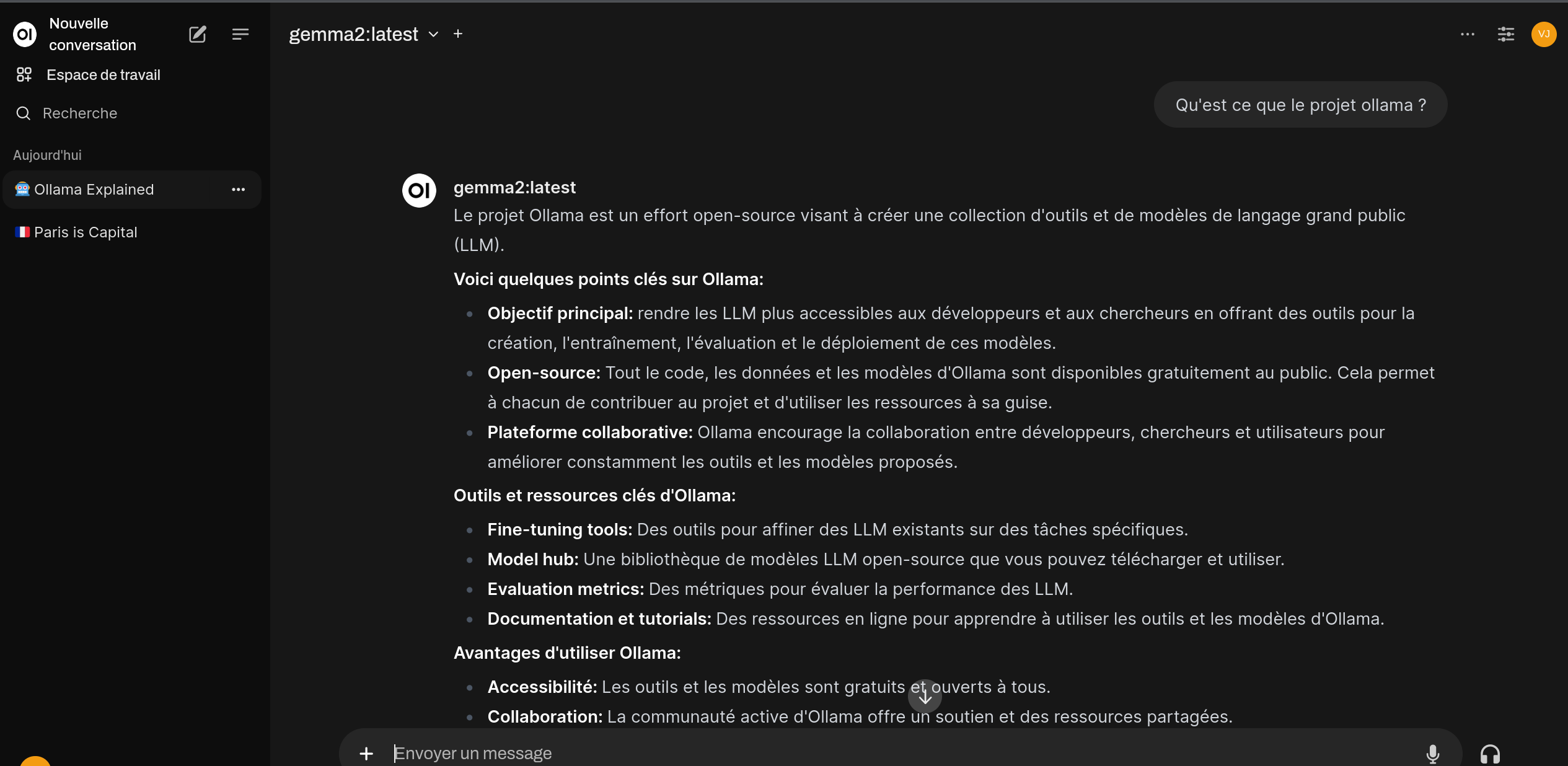

Dans cet article, nous installerons d'abord ollama qui est un outil facilitant le téléchargement, l'installation et la gestion de modèles LLM. Cet outil n'étant pas ergonomique, nous l'associerons à une IHM web openwebui. Cette interface ressemble aux interfaces classique pour dialoguer avec un assistant tel que celle de chatgpt ou celle de chat mistral ai. Elle est très facile d'emploi et vous permet de naviguer et d'utiliser aisément les modèles que vous avez récupéré ou mis à jour avec ollama.

Ce tutorial a été réalisé avec une machine PC comportant 32 Gb de RAM et une carte nvidia 3060 sous Mageia 9. Les drivers propriétaires de la carte nvidia ont été installés ainsi que l'extension opencl.

Pré-Requis sur une environnement nvidia

Le driver propriétaire nvidia doit être installé préalablement

Code BASH :

urpmi nvidia-current-cuda-opencl

Pré-Requis sur une environnement amd

Code BASH :

rocm-amd-opencl

Installation de docker et de pip

Code BASH :

urpmi python3-pip docker docker-compose

systemctl enable docker.service

systemctl start docker.serviceInstallation d'ollama

Code BASH :

curl https://ollama.ai/install.sh | sh systemctl enable ollama.service systemctl start ollama.service

Installation de modèle localement

On décrit ici comment simplement télécharger et déployer un modèle LLM sur votre machine.

Téléchargement du modèle gemma2 9B - 9 milliards de paramètres- 5.5GB

Code BASH :

ollama pull gemma2

Téléchargement du modèle Mistral 7B - 7 milliards de paramètres 4.1GB

Code BASH :

ollama pull mistral

Téléchargement du modèle llama3.1 8B - 8 milliards de paramètres 4.7GB

Code BASH :

ollama pull llama3.1

Pour d'autres modèles voir le catalogue https://ollama.com/library

Installation de openwebui pour interagir avec le modèle

Openwebui sera déployé et installé avec l'image docker proposé par l'équipe projet.

Code BASH :

docker run -d --network=host -v open-webui:/app/backend/data -e OLLAMA_BASE_URL=http://127.0.0.1:11434 --name open-webui --restart always ghcr.io/open-webui/open-webui:main

- -v open-webui:/app/backend/data : Cela monte un volume nommé open-webui dans le répertoire /app/backend/data du conteneur.

- -d : Cette option signifie “détaché” et permet d’exécuter le conteneur en arrière-plan.

- --name open-webui : Cela attribue le nom “open-webui” au conteneur.

- --restart always : Cette option spécifie que le conteneur doit toujours redémarrer automatiquement en cas d’échec.

- ghcr.io/open-webui/open-webui:main : C’est l’image à partir de laquelle le conteneur sera créé

- --network=host Indicateur permettant de résoudre les soucis de connexion entre le conteneur et le service ollama qui expose le modèle.

- OLLAMA_BASE_URL=http://127.0.0.1:11434 , url de communication avec le service ollama, peut être configuré au niveau de l'ihm openwebui

Se connecter ensuite à l'ihm à l'adresse http://localhost:8080

La création d'un compte est à réaliser une première fois.

On peut paramétrer le modèle utilisé soit au niveau de la partie administration pour tout les utilisateurs, soit au niveau du prompt.

Rappel des principales commandes docker

https://docs.docker.com/get-started/docker_cheatsheet.pdf

Rédigé par le vouf le 06/09/2024