Traitement d'images

La manip' du pendule optique

Logiciels / Graphisme photo et vidéo

Jybz Membre non connecté

-

- Voir le profil du membre Jybz

- Inscrit le : 10/10/2018

- Groupes :

-

Administrateur

-

Forgeron

Reprise du message précédent

Le programme est multi-thread ? Comment c'est géré/conçu ?Téléverser une image : /wiki/hebergement-de-fichiers-sur-mlo

| Arch | Machine | OS |

| x86_64 | lenovo x250 | mga9 |

| armv7hl | bananapro | mga9 |

| aarch64 | Raspberry Pi 4B | mga9 |

archimedium Membre non connecté

-

- Voir le profil du membre archimedium

- Inscrit le : 07/08/2012

- Site internet

- Groupes :

Citation :

Le programme est multi-thread ? Comment c'est géré/conçu ?

La version de Mageia 8 correspond à une ditribution 32bits, et la caméra a une connectique firewire ... Heu, quoi dire ? Ça pourrait aller beaucoup plus vite

Jybz Membre non connecté

-

- Voir le profil du membre Jybz

- Inscrit le : 10/10/2018

- Groupes :

-

Administrateur

-

Forgeron

Je vois qu'il y a deux étapes, une première on voit défiler les images, et la seconde on voit déterminer les coefficients.

Est-ce qu'il peut y avoir un thread dans la première étape, puis une distribution sur X threads la seconde étapes en fournissant un jeu de deux images à chaque threads, ils calculent, puis rendent le résultat avant de se servir dans le jeu des images non traitées ?

Téléverser une image : /wiki/hebergement-de-fichiers-sur-mlo

| Arch | Machine | OS |

| x86_64 | lenovo x250 | mga9 |

| armv7hl | bananapro | mga9 |

| aarch64 | Raspberry Pi 4B | mga9 |

Yuusha Membre non connecté

-

- Voir le profil du membre Yuusha

- Inscrit le : 04/07/2017

- Groupes :

-

Modérateur

-

Administrateur

-

Forgeron

archimedium Membre non connecté

-

- Voir le profil du membre archimedium

- Inscrit le : 07/08/2012

- Site internet

- Groupes :

C'est à dire que Mandrake GNU/Linux n'existait pas encore, et que j'utilisais plutôt RedHat GNU/Linux et Solaris sur SUN/SPARC. On n'utilisait pas les "threads" pour paralléliser le code, mais des "process" qui se lançaient en multitâche, et il n'existait pas encore de machines multi-processeurs. J'utilise toujours le "multi-processing" avec des "process" dont la charge est répartie sur les quatre coeurs, par le noyau Linux. J'essaye de tirer le meilleur parti des ressources de parallélisme qui sont disponibles sur le matériel, qui a 15 ans

C'est à dire que Mandrake GNU/Linux n'existait pas encore, et que j'utilisais plutôt RedHat GNU/Linux et Solaris sur SUN/SPARC. On n'utilisait pas les "threads" pour paralléliser le code, mais des "process" qui se lançaient en multitâche, et il n'existait pas encore de machines multi-processeurs. J'utilise toujours le "multi-processing" avec des "process" dont la charge est répartie sur les quatre coeurs, par le noyau Linux. J'essaye de tirer le meilleur parti des ressources de parallélisme qui sont disponibles sur le matériel, qui a 15 ans

archimedium Membre non connecté

-

- Voir le profil du membre archimedium

- Inscrit le : 07/08/2012

- Site internet

- Groupes :

Citation :

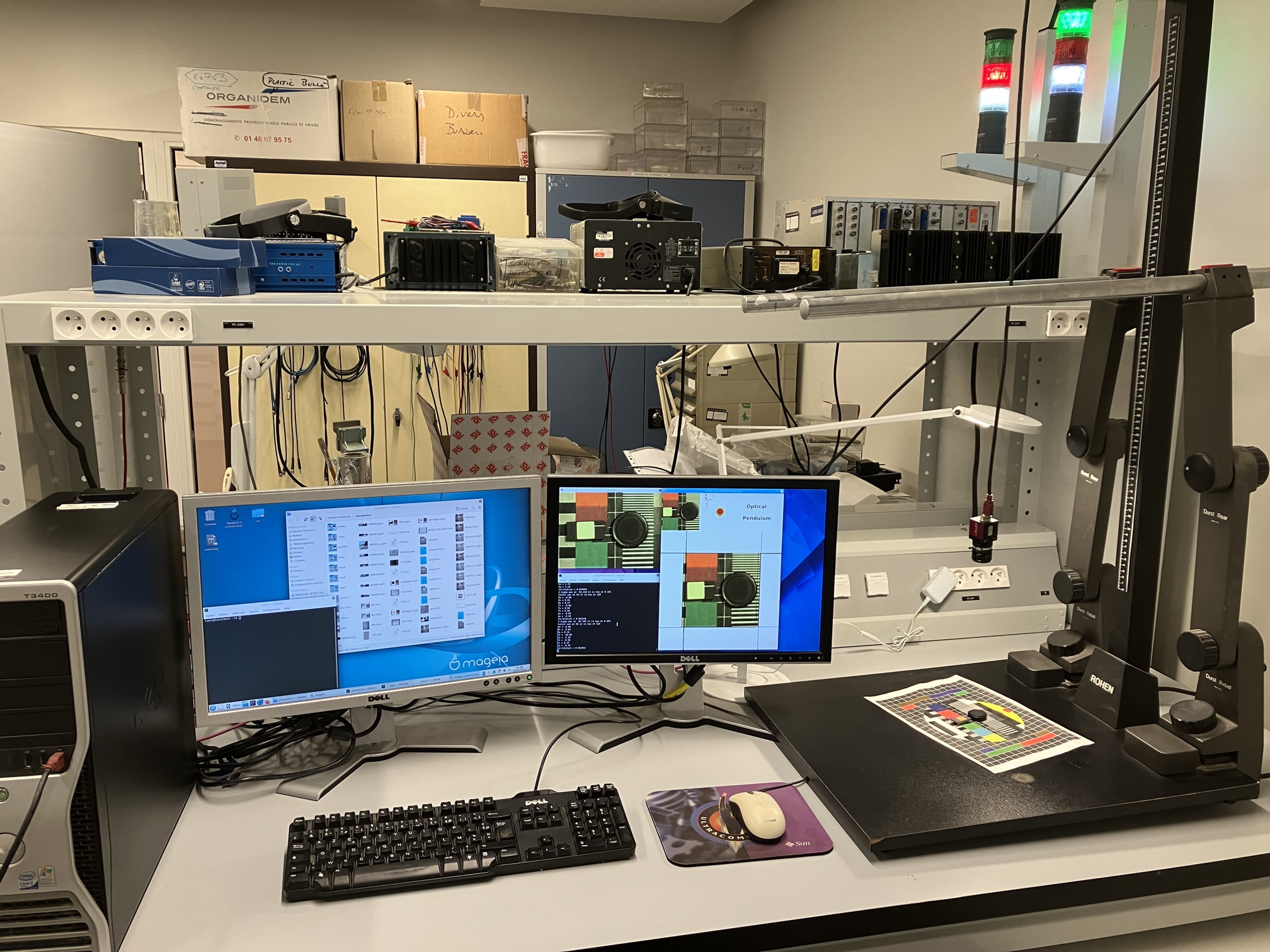

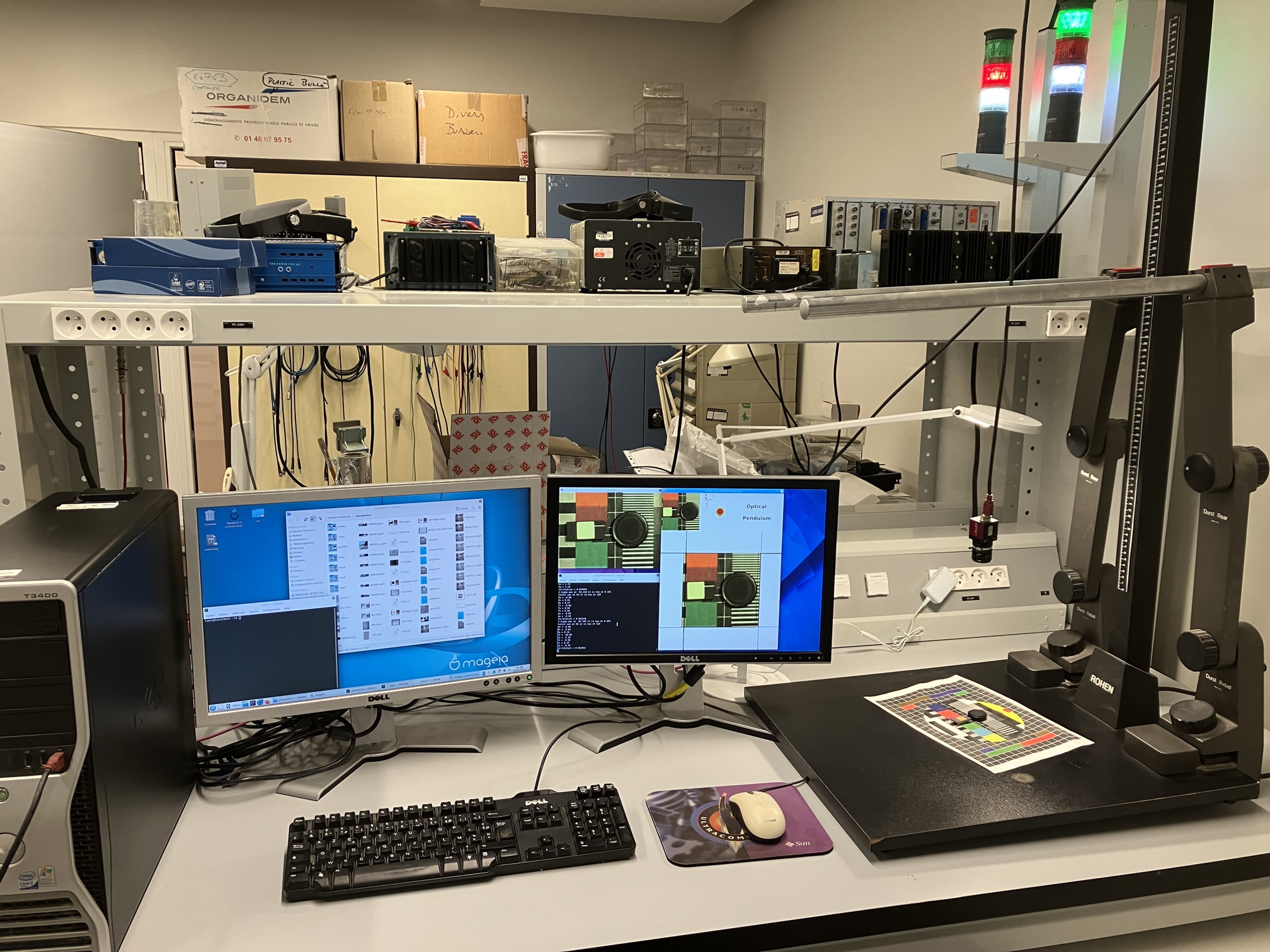

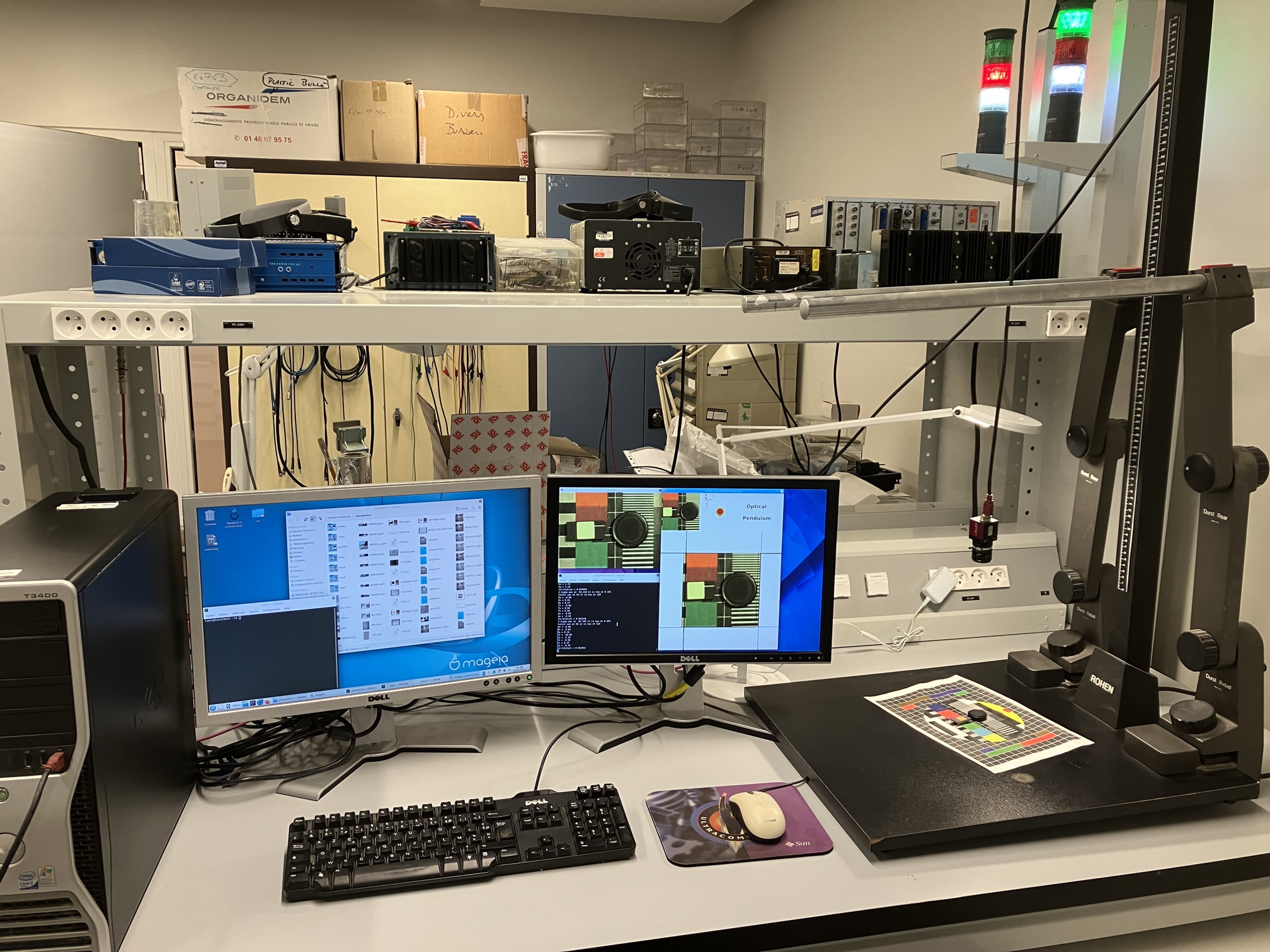

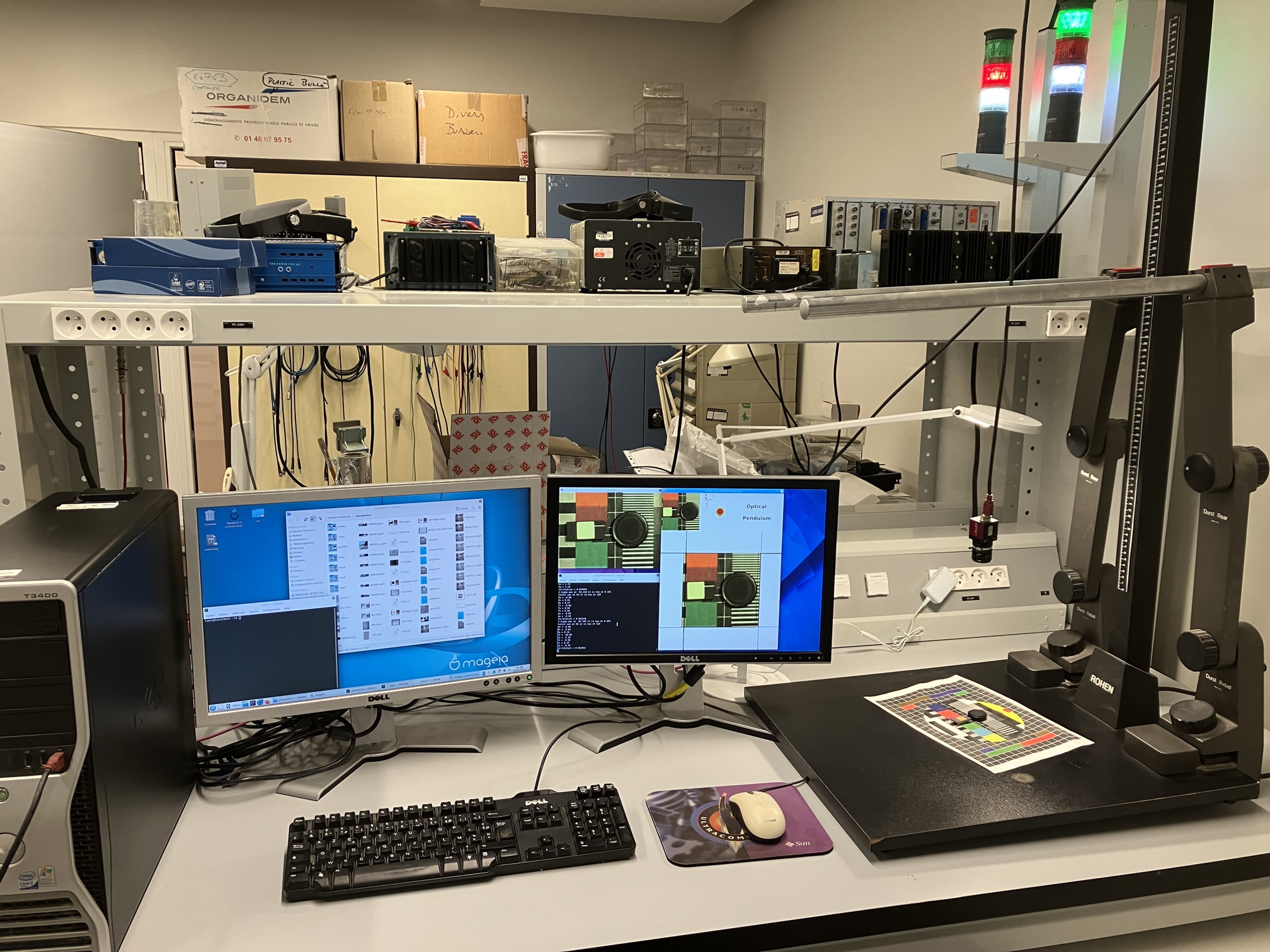

Voila la manip' du pendule optique ...

Nous approximons les transformations d'images en translation, en rotation et en perspective.

Sur sa page WEB on peut voir le pendule osciller en live ... Ça n'est pas très rapide pour le moment, mais nous essayons de l’accélérer

Nous approximons les transformations d'images en translation, en rotation et en perspective.

Sur sa page WEB on peut voir le pendule osciller en live ... Ça n'est pas très rapide pour le moment, mais nous essayons de l’accélérer

Je ne connais personne d'autre qui travaille sur une telle manip'. Ça nécessite seulement un ordinateur et une caméra. C'est tellement simple, mais intéressant ! Beaucoup de gens essaient de faire correspondre les images de la meilleure façon, mais il n'y a pas de réelle expérience comme celle-ci dite du "pendule optique", pour autant que je sache ?

archimedium Membre non connecté

-

- Voir le profil du membre archimedium

- Inscrit le : 07/08/2012

- Site internet

- Groupes :

Citation :

Je ne connais personne d'autre qui travaille sur une telle manip'. Ça nécessite seulement un ordinateur et une caméra. C'est tellement simple, mais intéressant ! Beaucoup de gens essaient de faire correspondre les images de la meilleure façon, mais il n'y a pas de réelle expérience comme celle-ci dite du "pendule optique", pour autant que je sache ?

Citation :

Voila la manip' du pendule optique ...

Nous approximons les transformations d'images en translation, en rotation et en perspective.

Sur sa page WEB on peut voir le pendule osciller en live ... Ça n'est pas très rapide pour le moment, mais nous essayons de l’accélérer

Nous approximons les transformations d'images en translation, en rotation et en perspective.

Sur sa page WEB on peut voir le pendule osciller en live ... Ça n'est pas très rapide pour le moment, mais nous essayons de l’accélérer

Je ne connais personne d'autre qui travaille sur une telle manip'. Ça nécessite seulement un ordinateur et une caméra. C'est tellement simple, mais intéressant ! Beaucoup de gens essaient de faire correspondre les images de la meilleure façon, mais il n'y a pas de réelle expérience comme celle-ci dite du "pendule optique", pour autant que je sache ?

L'expression de la transformation projective planaire a été ajoutée à la page WEB du pendule optique. C'est le modèle cinématique qui permet de mettre en correspondance les images. Un calcul formel a été réalisé avec le logiciel Mathematica, dont on voit une capture d'écran.

Nous effectuons une mise en correspondance dynamique des images. Nous obtenons une mesure similaire à celle d'une centrale inertielle.

archimedium Membre non connecté

-

- Voir le profil du membre archimedium

- Inscrit le : 07/08/2012

- Site internet

- Groupes :

Le survol de Mars est une réussite avec le système GNU/Linux embarqué.

Il n'y a qu'à voir la vidéo anniversaire de la NASA ...

Cela fait deux ans, cinquante survols et un hiver passés sur la planète.

Édité par archimedium Le 11/09/2023 à 17h05

archimedium Membre non connecté

-

- Voir le profil du membre archimedium

- Inscrit le : 07/08/2012

- Site internet

- Groupes :

L'agence américaine NASA ne semble plus diffuser d'images depuis le 50ième décollage.

Édité par archimedium Le 11/09/2023 à 17h05

archimedium Membre non connecté

-

- Voir le profil du membre archimedium

- Inscrit le : 07/08/2012

- Site internet

- Groupes :

Citation :

J'ai réalisé une page WEB à propos du 18ème survol de la planète Mars, par l'hélicoptère Ingenuity :

Il est possible de reconstruire le relief visible, et la trajectoire du drone Ingenuity, à l'aide d'une simple séquence vidéo. La disparité monoculaire s'obtient après la mise en correspondance des images avec une référence, par la mesure du flot-optique. La trajectoire est obtenue à l'aide des paramètres de la transformation projective qui relie les images successives ...

https://hebergement.universite-paris-saclay.fr/lecoat/demoweb/trajectory.html

Depuis le 19 avril 2021, l'hélicoptère Ingenuity qui a été envoyé sur Mars, n'a pas cessé de faire des survols de la planète. Il était prévu qu'il ne décolle que 5 fois, pour démontrer que c'était réalisable. Mais en fait, nous sommes en février 2022, et une dernière réalisation de 19ème survol de Mars, a été tentée. Les mesures que nous effectuons correspondent au 18ème survol de la planète Mars, en date du 15 décembre 2021.

La localisation de la caméra d'assistance au pilotage qui est obtenue, n'est pas parfaite. L'optique de cette caméra possède en effet une distorsion radiale, qui n'est pas prise en compte par le modèle cinématique projectif.

Il est possible de reconstruire le relief visible, et la trajectoire du drone Ingenuity, à l'aide d'une simple séquence vidéo. La disparité monoculaire s'obtient après la mise en correspondance des images avec une référence, par la mesure du flot-optique. La trajectoire est obtenue à l'aide des paramètres de la transformation projective qui relie les images successives ...

https://hebergement.universite-paris-saclay.fr/lecoat/demoweb/trajectory.html

Depuis le 19 avril 2021, l'hélicoptère Ingenuity qui a été envoyé sur Mars, n'a pas cessé de faire des survols de la planète. Il était prévu qu'il ne décolle que 5 fois, pour démontrer que c'était réalisable. Mais en fait, nous sommes en février 2022, et une dernière réalisation de 19ème survol de Mars, a été tentée. Les mesures que nous effectuons correspondent au 18ème survol de la planète Mars, en date du 15 décembre 2021.

La localisation de la caméra d'assistance au pilotage qui est obtenue, n'est pas parfaite. L'optique de cette caméra possède en effet une distorsion radiale, qui n'est pas prise en compte par le modèle cinématique projectif.

Nous sommes en août 2023, et l'hélicoptère Ingenuity survole toujours Mars. Il n'y a pas de système satellite GPS sur la planète et une très faible atmosphère par rapport à la Terre, mais il se localise avec une caméra en niveaux de gris qui pointe vers le sol, et cela fonctionne ... Voici une vidéo sur Youtube. Les traitements d'images sont obtenus à partir d'une interpolation qui est là sur Twitter par Simeon Schmauß. C'est parce que la vidéo est trop clairsemée quand elle est transmise au laboratoire JPL/NASA de l'Université Caltech

Ingenuity a effectué son 55ième vol le 12 août 2023, ce qui démontre la robustesse du système GNU/Linux, y compris dans des conditions particulièrement hostiles, un environnement inconnu et une supervision minime, puisque l'hélicoptère est quasiment autonome, très très loin de tout dans l'espace.

Édité par archimedium Le 18/08/2023 à 18h46

archimedium Membre non connecté

-

- Voir le profil du membre archimedium

- Inscrit le : 07/08/2012

- Site internet

- Groupes :

Sur Mastodon par Simeon Schmauß le 07/10/2023

#Ingenuity #Perseverance #Mars2020 #Mars #NASA #Solarocks

https://mastodon.iriseden.eu/@archimedium/111216593404796880

Voici un aperçu du 59ième vol d'Ingenuity sur Mars, capturé par la Mastcam-Z sur le rover Perseverance. De ce point de vue, j'ai fortement amélioré la poussière soufflée pendant le décollage. Vous pouvez également voir Dust Devils se déplacer en arrière-plan !

Papoteur Membre non connecté

-

- Voir le profil du membre Papoteur

- Inscrit le : 03/10/2011

- Groupes :

-

Modérateur

-

Équipe Mageia

-

Administrateur

-

Forgeron

Toujours aussi intriguant

Les tourbillons que l'on voit dans la vidéo ont-ils un lien avec le vol du drone, ou est-ce une coïncidence ?

Yves

archimedium Membre non connecté

-

- Voir le profil du membre archimedium

- Inscrit le : 07/08/2012

- Site internet

- Groupes :

Puis comme il y a une très légère atmosphère, celle-ci est parcourue par des vents. Le nom de ces vents est "Dust Devils" en anglais. C'est ce que l'on voit en arrière plan de l'hélicoptère lorsqu'il survole la planète. Le but du vol complet que l'on voit ici, est de battre un record d'altitude. Ingenuity vole vraiment très haut. Il se trouve au creux d'un cratère, qui a probablement contenu de l'eau par le passé. Le but de la mission est de détecter d'éventuelles traces de vie, disparues ...

archimedium Membre non connecté

-

- Voir le profil du membre archimedium

- Inscrit le : 07/08/2012

- Site internet

- Groupes :

archimedium Membre non connecté

-

- Voir le profil du membre archimedium

- Inscrit le : 07/08/2012

- Site internet

- Groupes :

Lorsque l'on veut déterminer le mouvement, il existe deux hypothèses simplificatrices. Soit la caméra est fixe, et la scène observée est en mouvement. Soit la caméra bouge, et la scène observée est statique. Dans le cas présent la caméra est fixe, et elle observe la personne qui se situe devant l'ordinateur et qui bouge. Le but de l'expérimentation est de reconstruire le relief visible, par "disparité temporelle" ("monocular depth" en anglais) ...

https://hebergement.universite-paris-saclay.fr/lecoat/demoweb/profondeur.html

C'est à dire que nous obtenons la profondeur (inversement proportionnelle à la disparité) par la mesure du flot-optique, avec une seule caméra, alors que cette mesure est faite classiquement par vision binoculaire (pour la disparité spatiale). Une seule caméra suffit à la perception du relief. On peut le mesurer et le représenter en 3D, comme c'est montré dans cette présentation sur le WEB. Cette démo utilise la bibliothèque OpenCV pour les traitements d'images, et POV-Ray pour la représentation en 3D

archimedium Membre non connecté

-

- Voir le profil du membre archimedium

- Inscrit le : 07/08/2012

- Site internet

- Groupes :

1er drone

2ème drone

3ème drone

L'intérêt pour la forêt ici, vient du fait que les trajectoires sont courbes, afin d'éviter les obstacles. Elles se mesurent grâce à une transformée projective, et sont représentées par les paramètres <Ry,Rz,Tx,Tz> grâce à POV-Ray dans l'espace. L'évolution du drone est présentée de face avec sa caméra.

Édité par archimedium Le 19/04/2024 à 16h10

Répondre

Vous n'êtes pas autorisé à écrire dans cette catégorie